世界をリードする企業から信頼されています

完全に分離された高性能推論。インフラ負担なし。

推論と開発を分離。Model Vaultにモデルのスケーリングと提供を任せて、開発に集中しましょう。

所有コスト削減

GPU調達を含む、本番環境グレードのAIインフラストラクチャのプロビジョニングと運用コストを削減します。

パフォーマンス保証

リソース共有によるレート制限やパフォーマンスの低下なしに、自動スケーリングされる無制限の本番ワークロードを実行します。

完全ネットワーク分離

完全に分離されたモデル提供インフラストラクチャにより、独自のAIシステムをコンプライアンスに準拠させ、セキュアに保ち、制御下に置きます。

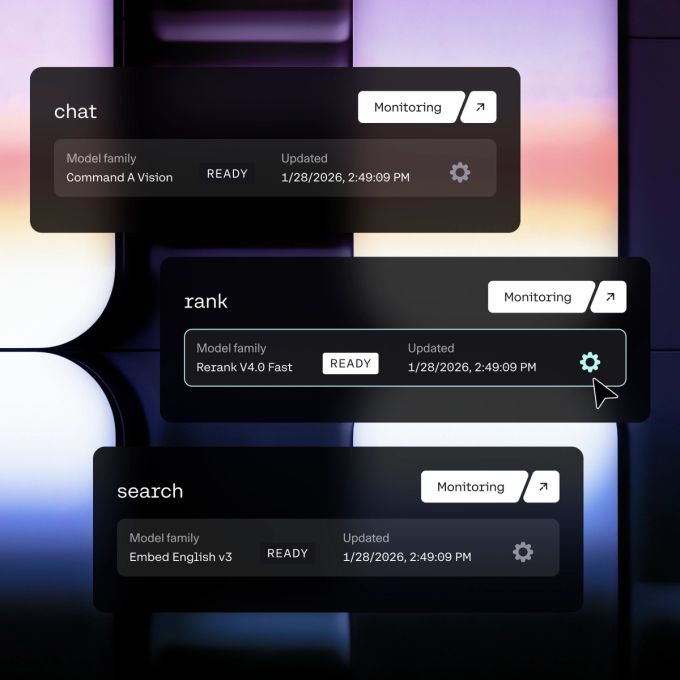

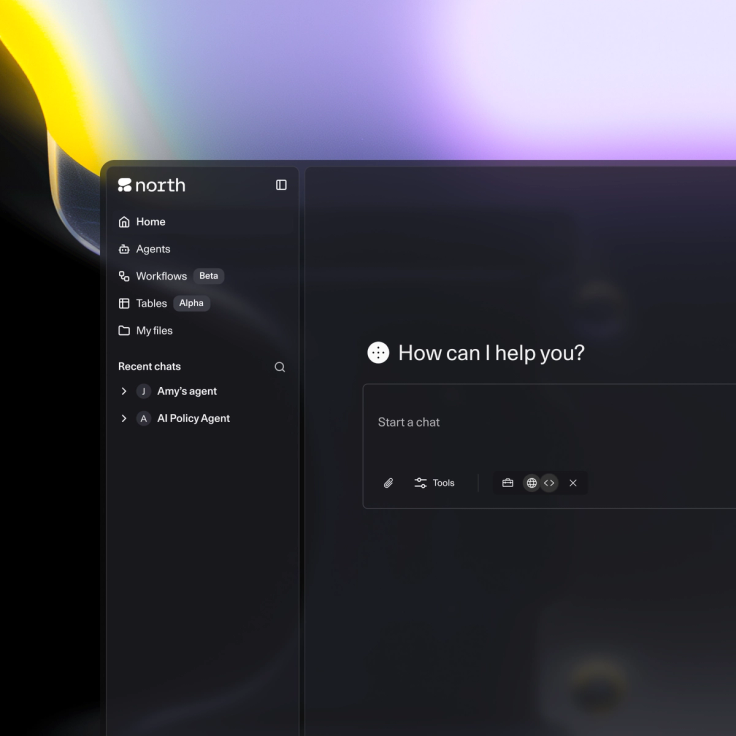

エンタープライズ級の管理。SaaSの簡単さ。

- モデルのデプロイ、メンテナンス、アップデート、スケーリングの完全な運用責任を負います。

- 最新の埋め込み、リランカー、生成モデルのすべてにアクセスできます。

- 数分でModel Vaultを作成し、新しいモデルを即座に起動できます。

- リクエストレート、レイテンシ、トークン使用量のライブ変更を追跡して、モデルの運用を最適化します。

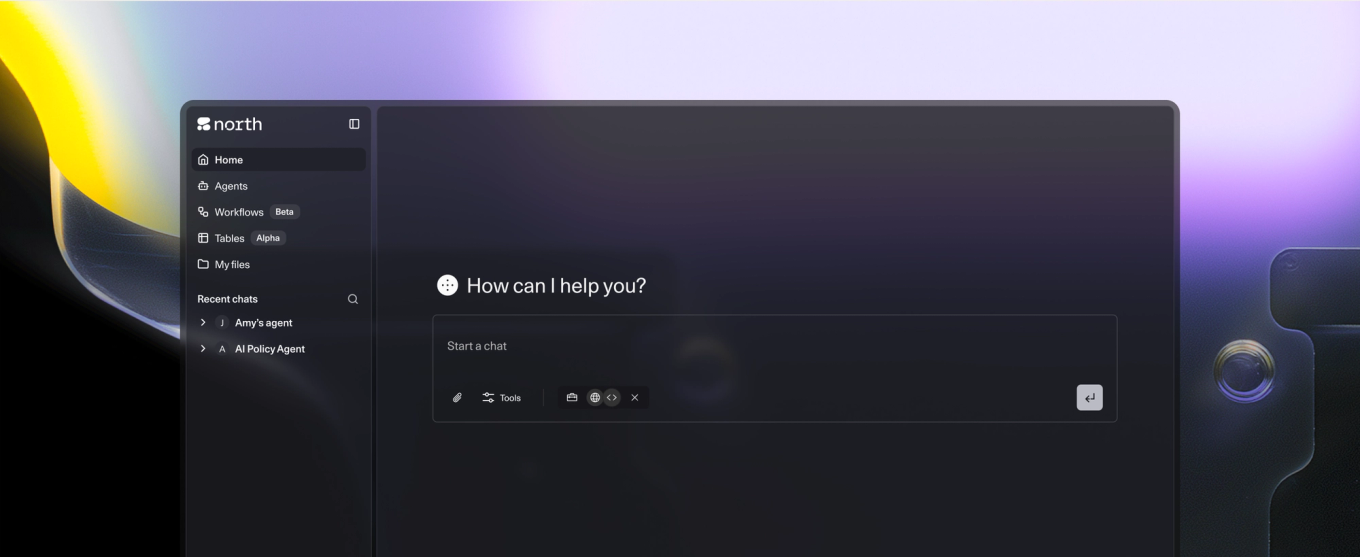

エージェンティックAIスタックを強化

当社のエンジニアと話し合い、Model Vaultが運用効率を向上させるポイントを特定しましょう。

エンタープライズワークロードのリソースを最適化する方法を理解する

セキュリティとコンプライアンスの状況に応じてデプロイする

これまで以上に迅速に本番環境対応モデルを立ち上げる方法を学ぶ

AIデプロイメントを

完全制御

プライベートデプロイメントのお客様として、ロールアウトのすべての段階で包括的な技術サポートを受けられます。

ソリューションアーキテクトが、お客様の特定のニーズに合わせてデプロイメントをカスタマイズするお手伝いをします。

応用機械学習(AML)チームが、AIモデルの精度と効率を最適化します。

カスタマーサクセスマネージャーが、デプロイメントが長期的なビジネス価値を提供できるようサポートします。